Webseiten für KI-Agenten erstellen: Warum maschinenlesbare Webarchitektur immer wichtiger wird

06.05.2026 um 10:03 Uhr, von Anne

Die Art, wie Websites genutzt werden, verändert sich gerade fundamental. Jahrzehntelang wurden Websites primär für Menschen entwickelt, visuell optimiert, interaktiv gestaltet und auf klassische Nutzerführung ausgerichtet. Doch mit dem Aufstieg von KI-Agenten verändert sich die Realität des Webs.

Systeme wie ChatGPT, Google Gemini oder zukünftige autonome Browser-Agenten greifen nicht mehr wie klassische Nutzer auf Websites zu. Sie analysieren Inhalte maschinell, interpretieren Strukturen und führen eigenständig Aktionen aus. Genau darum geht es im aktuellen web.dev-Artikel zu agentenfreundlichen Websites: Moderne Websites müssen nicht nur für Menschen lesbar sein, sondern auch für Maschinen verständlich werden.Wer sich intensiver mit den Auswirkungen auf SEO & GEO oder die Entwicklung von KI beschäftigt, merkt schnell: Maschinenlesbarkeit wird zu einem zentralen Wettbewerbsfaktor.

- Webseiten für KI-Agenten erstellen: Warum maschinenlesbare Webarchitektur immer wichtiger wird

- KI-Agenten sehen Websites völlig anders als Menschen

- Screenshots sind nur eine ergänzende Ebene

- Das DOM wird zum eigentlichen Fundament für KI-Agenten

- Accessibility Trees werden plötzlich strategisch relevant

- Moderne KI-Agenten kombinieren mehrere Signale gleichzeitig

- Webseiten für KI-Agenten erstellen: Worauf es jetzt ankommt

- Warum maschinenlesbare Webarchitektur jetzt zum SEO-Thema wird

- Meine Einschätzung: Viele Websites sind technisch nicht auf KI-Agenten vorbereitet

- Fazit: Websites müssen nicht nur nutzbar, sondern interpretierbar werden

KI-Agenten sehen Websites völlig anders als Menschen

Menschen konsumieren Websites visuell. Sie interpretieren Farben, Abstände, Design-Hierarchien und Bewegungen intuitiv. KI-Agenten hingegen arbeiten mit einer maschinenlesbaren Repräsentation der Website.

Der web.dev-Artikel beschreibt dabei drei zentrale Ebenen, über die Agenten Websites analysieren:

- Screenshots

- Raw HTML / DOM

- Accessibility Tree View

Das Entscheidende dabei:

Die Qualität dieser maschinenlesbaren Ebenen bestimmt maßgeblich, wie gut ein Agent mit einer Website arbeiten kann.

Screenshots sind nur eine ergänzende Ebene

Einige KI-Agenten erstellen Screenshots der gerenderten Website und analysieren diese mit Vision-Modellen. Dadurch können sie erkennen, wo sich beispielsweise eine Suchleiste befindet oder welche Buttons besonders relevant wirken. Größe, Farbe und Position dienen dabei als visuelle Hinweise. Der Artikel macht allerdings deutlich, dass dieser Ansatz eher als Ergänzung dient. Screenshot-Analysen sind langsam, teuer und fehleranfällig.

Vor allem bei komplexen oder dynamischen Interfaces entstehen Probleme. Wenn Elemente ständig ihre Position verändern oder wichtige Funktionen hinter Overlays liegen, wird die Interpretation schwierig.

Das zeigt bereits ein zentrales Problem moderner Websites: Viele Interfaces sind visuell beeindruckend, senden aber strukturell kaum klare Signale.

Das DOM wird zum eigentlichen Fundament für KI-Agenten

Deutlich wichtiger ist für Agenten die Analyse des DOMs und des rohen HTMLs.

Hier erkennt die KI:

- wie Inhalte strukturiert sind

- welche Elemente zusammengehören

- welche Hierarchien existieren

- welche Funktionen einzelne Elemente besitzen

Genau deshalb betont der Artikel die Bedeutung von semantischem HTML. Ein echter <button> ist für Agenten eindeutig als interaktives Element erkennbar. Ein visuell gestyltes <div> hingegen nicht unbedingt. Das klingt nach einer technischen Kleinigkeit, ist aber strategisch enorm relevant. Viele moderne Websites bestehen heute aus komplexen JavaScript-Interfaces mit generischen <div>-Containern. Für Menschen funktioniert das visuell problemlos. Für KI-Agenten entsteht jedoch oft eine semantische Grauzone.

Und genau diese Grauzonen werden künftig zum Problem für KI und agentenbasierte Interaktionen.

Accessibility Trees werden plötzlich strategisch relevant

Besonders spannend ist im web.dev-Artikel die Rolle der sogenannten Accessibility Tree View. Dabei handelt es sich um eine browsernative Darstellung, die das DOM auf seine funktionalen Kerninformationen reduziert:

- Rollen

- Namen

- Zustände

- Beziehungen interaktiver Elemente

Für unterstützende Technologien ist das seit Jahren wichtig. Für KI-Agenten wird es jetzt ebenfalls zentral. Denn Accessibility Trees liefern eine extrem präzise, maschinenlesbare Zusammenfassung der Website, ohne visuelles Rauschen durch CSS oder Animationen.

Dadurch verstehen Agenten deutlich besser:

- welche Elemente klickbar sind

- welche Funktion ein Element erfüllt

- welche Eingabefelder zusammengehören

- wie Nutzerflüsse aufgebaut sind

Der interessante Punkt dabei: Alles, was Accessibility verbessert, verbessert gleichzeitig oft auch die Interpretierbarkeit für KI-Agenten.

Moderne KI-Agenten kombinieren mehrere Signale gleichzeitig

Ein wichtiger Aspekt aus dem Artikel: Moderne Agenten verlassen sich nicht nur auf eine einzelne Datenquelle. Sie kombinieren:

- visuelle Analysen

- DOM-Strukturen

- Accessibility-Daten

- semantische Beziehungen

Dadurch entsteht ein wesentlich robusteres Verständnis der Website. Das bedeutet aber auch: Websites müssen auf mehreren Ebenen gleichzeitig konsistent sein. Wenn das HTML etwas anderes signalisiert als die visuelle Oberfläche oder Accessibility-Struktur, entstehen Interpretationsprobleme.

Webseiten für KI-Agenten erstellen: Worauf es jetzt ankommt

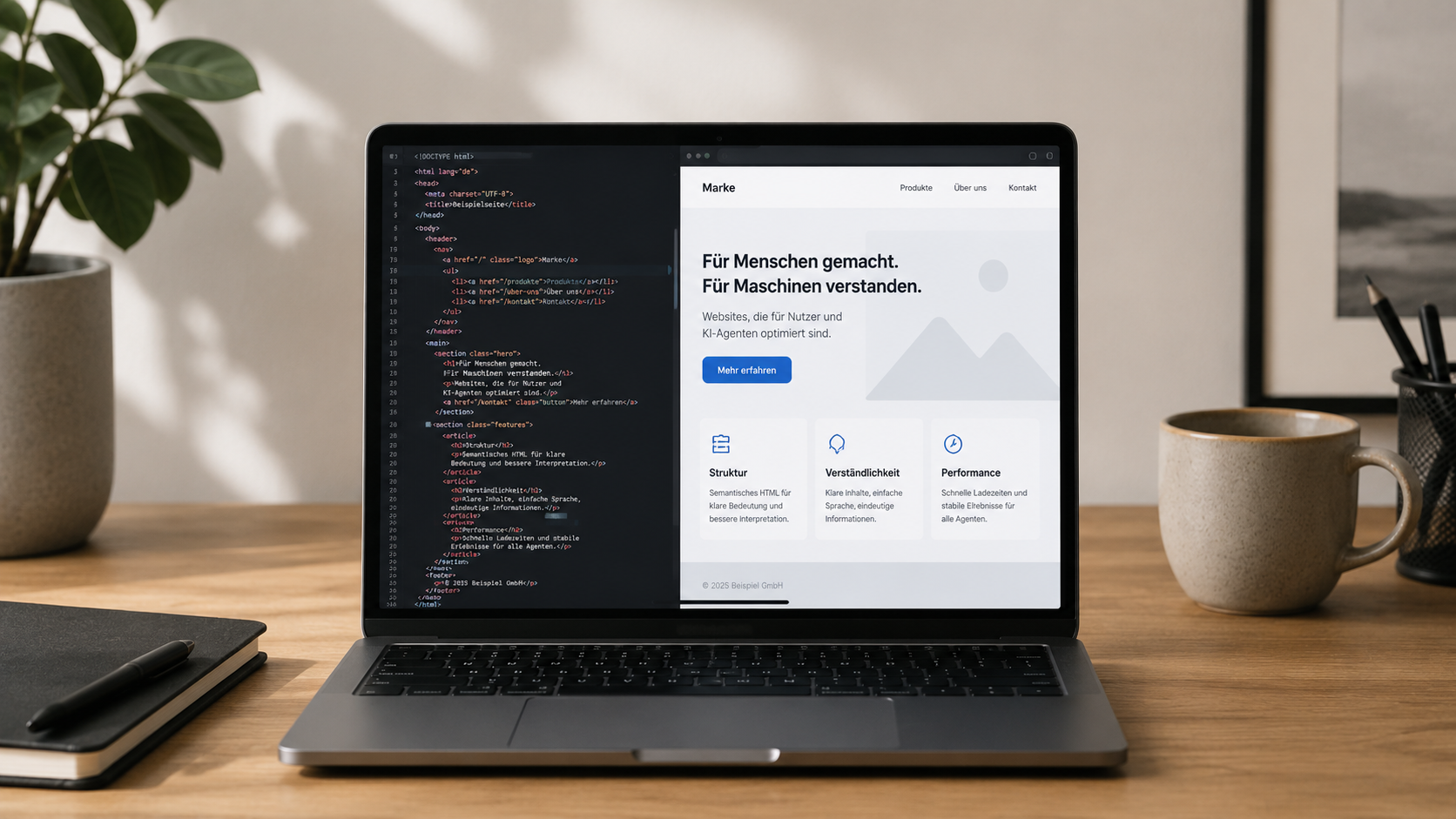

Der web.dev-Artikel nennt mehrere konkrete Prinzipien für agentenfreundliche Websites. Besonders wichtig ist die Verwendung von semantischem HTML. Interaktive Elemente sollten echte <button>- oder <a>-Elemente sein und keine umgebauten <div>-Konstruktionen.

Ebenso wichtig sind stabile Layouts. Wenn sich Elemente je nach Kontext ständig verschieben, erschwert das die Navigation für Agenten erheblich. Auch sogenannte „Geisterelemente“ oder transparente Overlays sollten vermieden werden, da sie die visuelle Analyse stören können. Ein weiterer zentraler Punkt ist die korrekte Verknüpfung von Formularfeldern und Labels. Dadurch kann ein Agent besser verstehen, welche Funktion ein Eingabefeld besitzt.

Der Artikel macht dabei deutlich: Viele dieser Maßnahmen sind keine neuen SEO-Tricks, sondern grundlegende Prinzipien sauberer Webarchitektur.

Warum maschinenlesbare Webarchitektur jetzt zum SEO-Thema wird

Die Auswirkungen reichen weit über technische Accessibility hinaus. KI-Systeme interpretieren Websites zunehmend eigenständig. Sie extrahieren Informationen, navigieren Interfaces und bauen Antworten direkt aus Webseitenstrukturen zusammen. Das verändert auch SEO und GEO grundlegend.

Sichtbarkeit entsteht künftig nicht mehr nur über Rankings, sondern auch darüber, wie gut Inhalte maschinell verarbeitet werden können. Passend dazu lohnt sich auch ein Blick auf Themen wie KI-Performance-Monitoring, da genau dort sichtbar wird, wie KI-Systeme Inhalte tatsächlich interpretieren und nutzen.

Meine Einschätzung: Viele Websites sind technisch nicht auf KI-Agenten vorbereitet

Die meisten aktuellen Websites wurden nie dafür gebaut, von autonomen Agenten genutzt zu werden. Sie funktionieren visuell gut, sind aber strukturell oft unnötig komplex. Zu viele dynamische Interfaces, semantisch schwache Konstruktionen und inkonsistente Nutzerflüsse erschweren die maschinelle Interpretation massiv. Genau deshalb wird maschinenlesbare Webarchitektur in den nächsten Jahren immer wichtiger werden. Nicht als kurzfristiger SEO-Hack sondern als fundamentale Voraussetzung für KI-kompatible Websites.

Fazit: Websites müssen nicht nur nutzbar, sondern interpretierbar werden

Der zentrale Punkt des web.dev-Artikels ist eigentlich erstaunlich simpel: KI-Agenten benötigen strukturierte, semantisch klare und maschinenlesbare Websites. Das verändert nicht nur technische Anforderungen, sondern langfristig die gesamte Art, wie Websites entwickelt werden.

Wer heute beginnt, Websites agentenfreundlich aufzubauen, verbessert nicht nur Accessibility oder technische Qualität. Er schafft die Grundlage dafür, dass Inhalte auch in zukünftigen AI-Systemen korrekt interpretiert und genutzt werden können. Denn die nächste Generation der Webnutzung klickt nicht einfach nur. Sie analysiert, interpretiert und handelt autonom.