Google AI Ecosystem: Wie Googles KI-Systeme wirklich zusammenarbeiten

10.04.2026 um 14:14 Uhr, von Anne

Warum man KI nicht isoliert betrachten darf

Wenn heute über künstliche Intelligenz gesprochen wird, fällt meist ein Name: Gemini. Doch dieser Fokus greift zu kurz. Gemini ist nicht das System, es ist nur ein sichtbarer Teil davon. Wer verstehen will, wie Google KI entwickelt, bewertet und in Produkte integriert, muss das gesamte Google AI Ecosystem betrachten. Denn Google verfolgt keinen punktuellen Ansatz, sondern baut eine durchgängige Architektur, in der Modelle, Daten, Infrastruktur und Anwendungen eng miteinander verzahnt sind.

Das Entscheidende dabei ist: KI funktioniert hier nicht als einzelnes Tool, sondern als System, das kontinuierlich lernt, sich anpasst und über verschiedene Ebenen hinweg wirkt.

Die Grundstruktur: Drei Ebenen eines vernetzten Systems

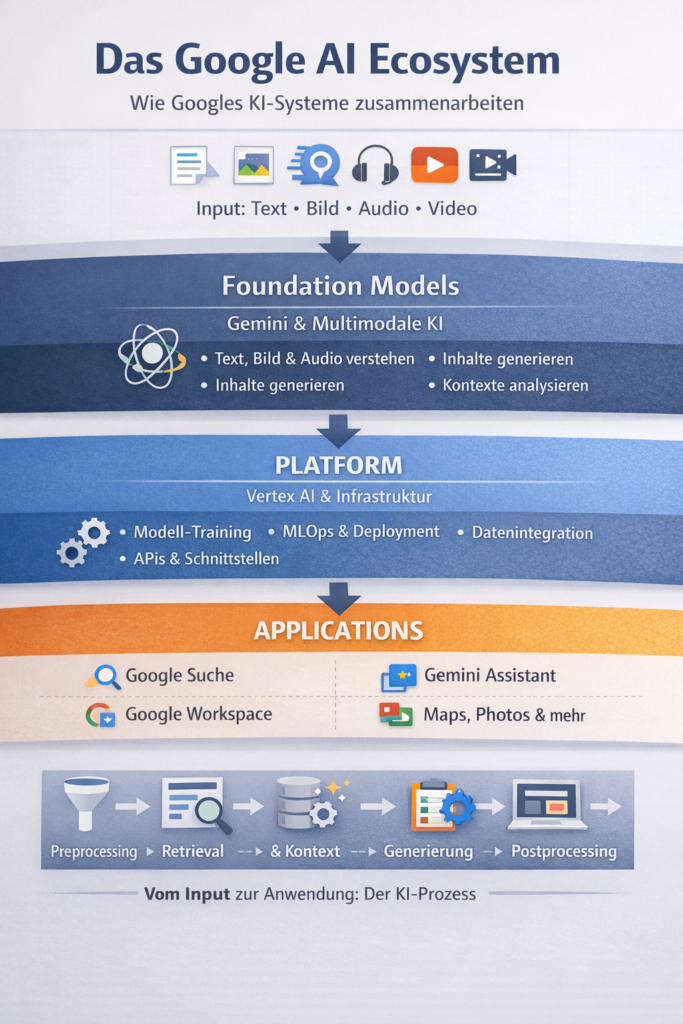

Das Google AI Ecosystem lässt sich in drei zentrale Ebenen unterteilen, die aufeinander aufbauen und gemeinsam funktionieren.

Im Kern stehen die Foundation Models, die als „Gehirn“ des Systems fungieren. Darauf aufbauend folgt die Plattform-Ebene rund um Vertex AI, die die operative Nutzung ermöglicht. An der Oberfläche befinden sich schließlich die Anwendungen, also die Produkte, mit denen Nutzer interagieren.

Diese Trennung ist nicht nur technisch relevant, sondern erklärt auch, wie Wertschöpfung entsteht: Modelle liefern die Intelligenz, Plattformen machen sie nutzbar und Anwendungen bringen sie in den Alltag.

Foundation Models: Das Zentrum der KI-Architektur

Im Zentrum des Systems stehen die Foundation Models, insbesondere die Gemini-Familie. Diese Modelle sind darauf ausgelegt, unterschiedliche Datentypen gleichzeitig zu verarbeiten und miteinander zu verknüpfen. Das bedeutet konkret, dass Texte, Bilder, Audio und sogar Video nicht mehr isoliert betrachtet werden, sondern in einem gemeinsamen Kontext verstanden werden können. Genau diese Multimodalität ist einer der größten technologischen Fortschritte der letzten Jahre.

Die Modelle übernehmen dabei die eigentliche „Denkarbeit“. Sie interpretieren Eingaben, erkennen Zusammenhänge, generieren Inhalte und treffen Vorhersagen. Ohne diese Ebene gäbe es keine intelligente Verarbeitung, nur Daten ohne Kontext.

Vertex AI: Die Plattform hinter der Anwendung

Während die Modelle die Intelligenz liefern, übernimmt Vertex AI die Rolle der Plattform. Hier werden Modelle bereitgestellt, trainiert, angepasst und skaliert. Vertex AI ist damit die operative Schicht des Systems. Sie verbindet Forschung und Anwendung und sorgt dafür, dass KI nicht nur existiert, sondern auch praktisch eingesetzt werden kann. Unternehmen können hier Modelle nutzen, eigene Daten integrieren und spezifische Anwendungsfälle entwickeln. Besonders wichtig ist, dass Vertex AI auch Prozesse wie Monitoring, Optimierung und Deployment integriert. KI wird dadurch nicht als statisches System betrieben, sondern als kontinuierlich lernende Umgebung.

APIs als Zugangspunkt zur KI

Die eigentliche Schnittstelle zwischen diesem komplexen System und realen Anwendungen sind die APIs. Sie ermöglichen es, auf die Fähigkeiten der Modelle zuzugreifen, ohne die zugrunde liegende Infrastruktur selbst aufbauen zu müssen. Google stellt hierfür unterschiedliche Zugänge bereit, die je nach Anwendungsfall variieren. Während einfache Anwendungen direkt über Entwickler-APIs auf Modelle zugreifen können, nutzen größere Systeme die skalierbaren Schnittstellen innerhalb von Vertex AI. Über diese APIs werden zentrale Funktionen bereitgestellt, etwa die Verarbeitung von Text, die Analyse von Bildern oder die Umwandlung von Sprache. Sie sind damit der Punkt, an dem KI in Produkte integriert wird.

Anwendungen: Wo KI für Nutzer sichtbar wird

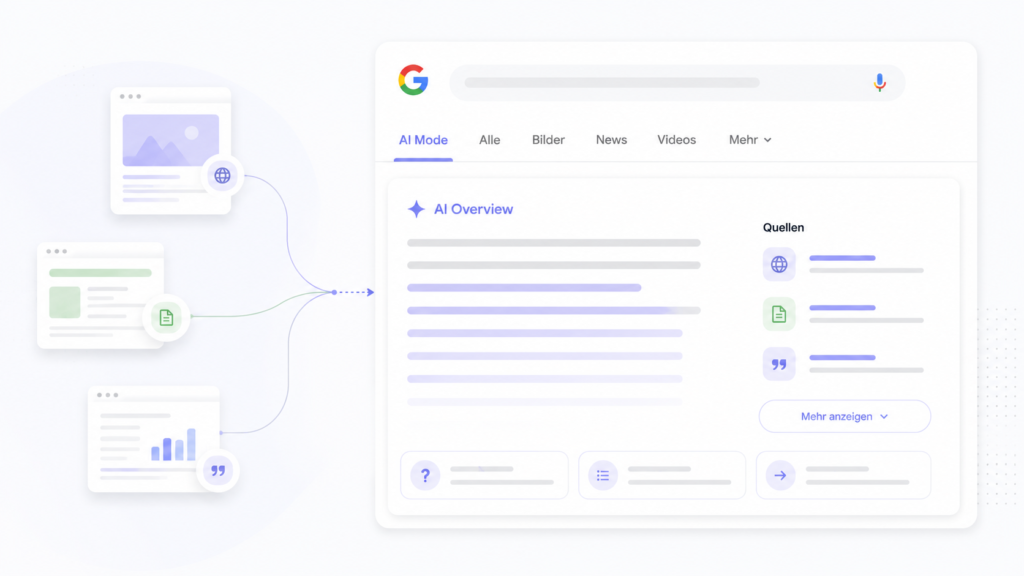

Auf der obersten Ebene stehen die Anwendungen. Hier wird KI für Nutzer greifbar, ohne dass sie die dahinterliegende Architektur wahrnehmen. Produkte wie die Google-Suche, Gemini selbst oder Anwendungen innerhalb von Google Workspace greifen auf die darunterliegenden Systeme zu und abstrahieren deren Komplexität. Für den Nutzer entsteht der Eindruck einer direkten Interaktion mit einer intelligenten Oberfläche, während im Hintergrund ein mehrstufiger Prozess abläuft.

Diese Trennung ist entscheidend, weil sie zeigt, dass die eigentliche Innovation nicht nur im Modell liegt, sondern im Zusammenspiel aller Ebenen.

Der Prozessflow: Wie KI-Anfragen verarbeitet werden

Um das System besser zu verstehen, hilft ein Blick auf den typischen Ablauf einer KI-Anfrage. Dieser Prozess ist nicht sichtbar, bestimmt aber maßgeblich die Qualität der Ergebnisse.

- Input: Der Nutzer gibt eine Anfrage ein, sei es als Text, Sprache oder Bild.

- Preprocessing: Die Eingabe wird strukturiert und für die Verarbeitung vorbereitet.

- Modellverarbeitung: Das Modell interpretiert den Input und analysiert Kontext sowie Bedeutung.

- Retrieval: Bei Bedarf werden externe Datenquellen hinzugezogen, um die Antwort zu ergänzen.

- Generierung: Auf Basis aller Informationen wird eine Antwort erzeugt.

- Postprocessing: Die Ausgabe wird strukturiert und optimiert.

- Output: Die Antwort wird im jeweiligen Interface dargestellt.

Dieser Ablauf zeigt deutlich, dass KI nicht einfach Antworten liefert, sondern durch mehrere Verarbeitungsschritte geht. Jede dieser Ebenen beeinflusst das Ergebnis.

Multimodalität: Der eigentliche Paradigmenwechsel

Ein zentraler Bestandteil des Google AI Ecosystems ist die Fähigkeit, verschiedene Datentypen gleichzeitig zu verarbeiten. Während frühere Systeme stark auf Text fokussiert waren, kombiniert Google heute Sprache, Bilder, Audio und Video in einem gemeinsamen Verständnisraum. Dadurch können komplexe Zusammenhänge besser erkannt und verarbeitet werden.

Für Nutzer bedeutet das intuitivere Interaktionen. Für Unternehmen bedeutet es, dass Inhalte nicht mehr nur geschrieben, sondern ganzheitlich gedacht werden müssen.

Infrastruktur: Die Basis für Skalierung

Hinter all diesen Ebenen steht eine massive Infrastruktur. Google betreibt spezialisierte Hardware wie TPUs sowie globale Cloud-Systeme, die die Verarbeitung großer Datenmengen ermöglichen. Diese Infrastruktur sorgt dafür, dass KI nicht nur leistungsfähig, sondern auch skalierbar ist. Ohne sie wäre es nicht möglich, Milliarden von Anfragen in Echtzeit zu verarbeiten und gleichzeitig komplexe Modelle einzusetzen. Sie ist damit die unsichtbare Grundlage des gesamten Systems.

Bedeutung für SEO und Online-Marketing

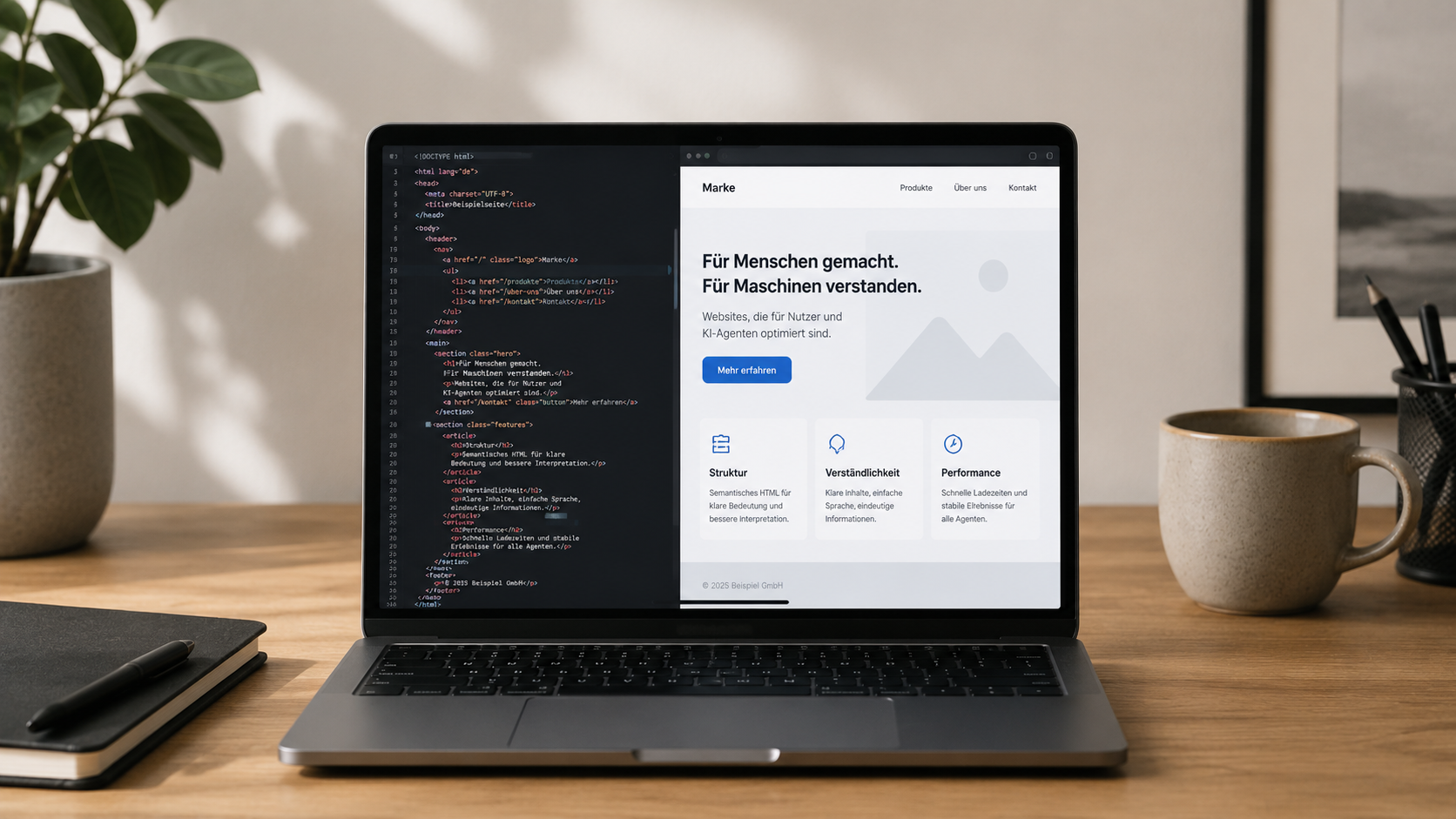

Für SEO und Online-Marketing verändert dieses Ecosystem die Spielregeln grundlegend. Inhalte werden nicht mehr nur gecrawlt und indexiert, sondern interpretiert und in einen größeren Kontext eingeordnet. Das bedeutet, dass klassische Optimierungsansätze allein nicht mehr ausreichen. Statt Keywords rücken Verständlichkeit, Struktur und Kontext in den Fokus. Marken werden als Entitäten bewertet, Inhalte als Teil eines Wissensraums verstanden.

Sichtbarkeit entsteht damit nicht mehr nur auf der Suchergebnisseite, sondern innerhalb eines Systems, das Antworten generiert.

Fazit: Google baut ein System, kein Feature

Das Google AI Ecosystem zeigt deutlich, wohin sich digitale Systeme entwickeln. KI ist kein einzelnes Produkt, sondern ein Zusammenspiel aus Modellen, Plattformen, APIs und Anwendungen. Die zentrale Erkenntnis daraus ist, dass Sichtbarkeit nicht mehr nur davon abhängt, gefunden zu werden. Entscheidend ist vielmehr, ob Inhalte im System verstanden und richtig eingeordnet werden.

Oder anders formuliert:

Die Frage ist nicht mehr, ob du sichtbar bist. Sondern, ob du im System eine Rolle spielst.

Quelle: medium.com