Common Crawl & Web Graph Data: Wie SEOs die Datenbasis der KI verstehen (und nutzen)

07.04.2026 um 11:50 Uhr, von Anne

Common Crawl und Web Graph Data verschieben den Blick von Rankings hin zur zugrunde liegenden Datenstruktur des Webs. Sichtbarkeit entsteht dadurch zunehmend über Vernetzung, Kontext und die Einbettung von Inhalten in das digitale Gesamtgefüge, das auch KI-Systeme prägt.

- Common Crawl & Web Graph Data: Wie SEOs die Datenbasis der KI verstehen (und nutzen)

- Was Common Crawl ist und warum es für SEO plötzlich wichtig wird

- Die Common-Crawl-Datenbank: Rohmaterial für Maschinen

- Der Web Graph: Wie das Internet wirklich vernetzt ist

- Warum der Web Graph für SEO so wertvoll ist

- Wie SEOs diese Daten konkret nutzen können

- Die Verbindung zu KI-Ranking-Signalen

- SEO wird zur Netzwerk-Analyse

- Fazit: Wer die Daten versteht, versteht die Zukunft der Suche

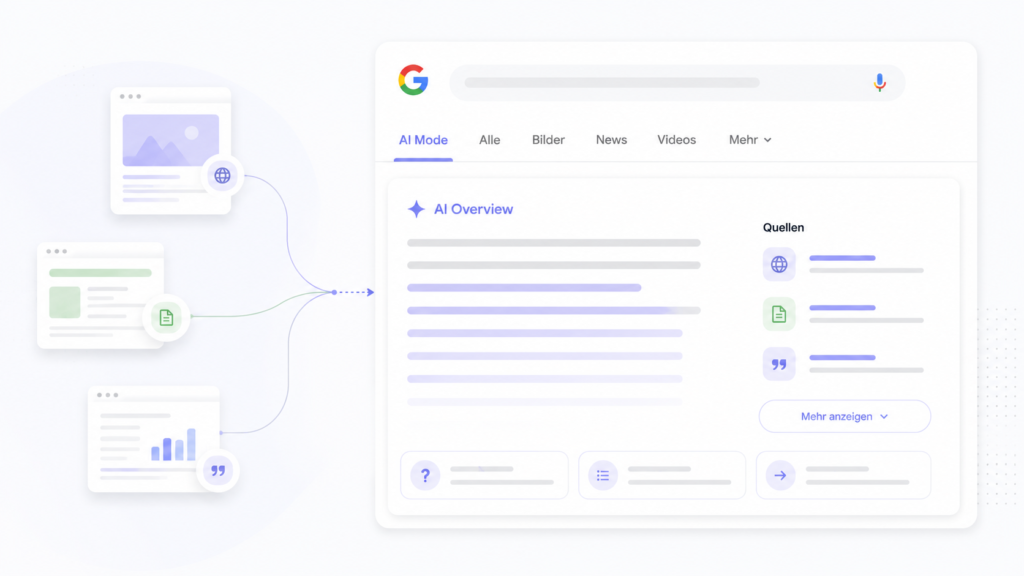

Wenn heute über KI-Sichtbarkeit gesprochen wird, geht es meist um Systeme wie Gemini, ChatGPT oder Perplexity. Was dabei oft untergeht: Diese Systeme basieren nicht nur auf Algorithmen, sondern vor allem auf Daten. Und eine der wichtigsten Quellen dieser Daten ist Common Crawl.

Damit verschiebt sich die Perspektive. Wer verstehen will, wie KI Inhalte bewertet, muss sich nicht nur mit Rankings beschäftigen, sondern mit der Frage, welche Daten überhaupt in diese Systeme eingeflossen sind. Genau hier wird Common Crawl relevant, nicht als Tool, sondern als Fundament.

Was Common Crawl ist und warum es für SEO plötzlich wichtig wird

Common Crawl ist eine gemeinnützige Organisation, die seit vielen Jahren das Web crawlt und die gesammelten Daten öffentlich zur Verfügung stellt. Monat für Monat entstehen dabei riesige Datensätze, die einen großen Teil des offenen Webs abbilden. Im Gegensatz zu Google handelt es sich dabei nicht um einen fertigen Index, sondern um Rohdaten. Webseiten werden gesammelt, gespeichert und strukturiert bereitgestellt, ohne Bewertung, ohne Ranking. Gerade das macht die Daten so interessant. Sie zeigen nicht, wie Google das Web interpretiert, sondern wie es tatsächlich strukturiert ist. Und genau diese Perspektive wird für SEO zunehmend wertvoll.

Die Common-Crawl-Datenbank: Rohmaterial für Maschinen

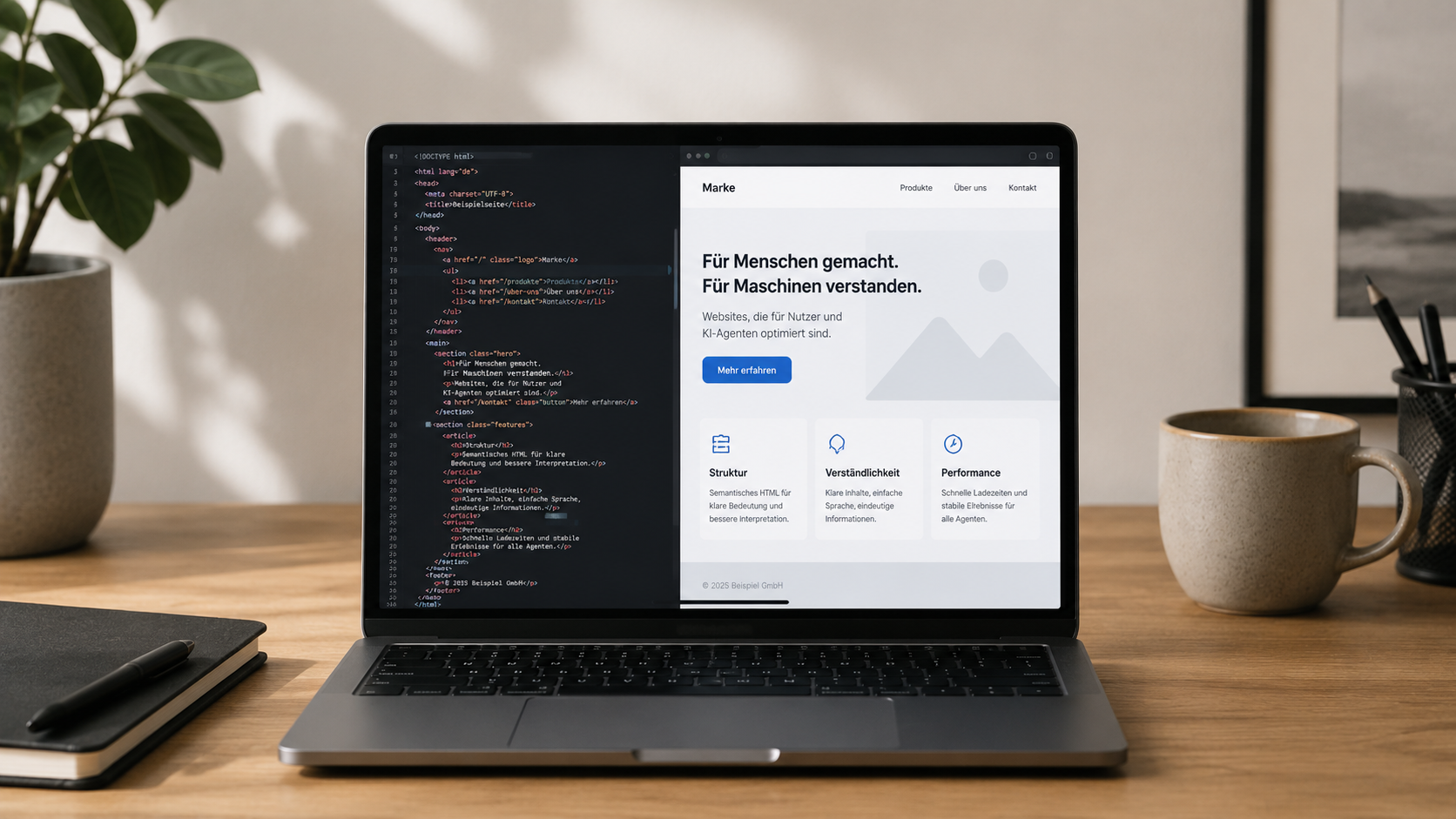

Die Daten, die Common Crawl bereitstellt, sind technisch komplex, aber konzeptionell einfach zu verstehen. Sie bestehen aus verschiedenen Ebenen, die jeweils unterschiedliche Aspekte des Webs abbilden. Zum einen gibt es vollständige HTML-Snapshots von Webseiten, zum anderen strukturierte Metadaten und extrahierte Textinhalte. Ergänzt wird das Ganze durch Indexdaten, die eine gezielte Analyse ermöglichen. Man kann sich das wie ein riesiges Archiv vorstellen, nur dass dieses Archiv nicht für Menschen gedacht ist, sondern für Maschinen. Und genau hier liegt der Zusammenhang zur KI: Viele Modelle wurden auf genau solchen Daten trainiert oder greifen auf ähnliche Quellen zurück. Wer also in diesen Datensätzen präsent ist, hat eine höhere Wahrscheinlichkeit, von KI-Systemen „gesehen“ zu werden.

Der Web Graph: Wie das Internet wirklich vernetzt ist

Besonders spannend wird es mit den sogenannten Web Graph Data. Hier wird das Web nicht als Sammlung von Seiten betrachtet, sondern als Netzwerk. Jede Website ist ein Knoten, jeder Link eine Verbindung. Aus Milliarden solcher Verbindungen entsteht ein riesiger Graph, der zeigt, wie Inhalte miteinander verknüpft sind. Diese Struktur ist keine theoretische Spielerei, sondern bildet die Grundlage vieler Ranking-Modelle. Schon der ursprüngliche PageRank basierte auf genau diesem Prinzip. Der Unterschied heute: Während Google seinen eigenen Graph nutzt, stellt Common Crawl eine offene Version davon bereit. Das bedeutet, dass SEOs erstmals einen relativ unverfälschten Blick auf die Struktur des Webs bekommen können.

Warum der Web Graph für SEO so wertvoll ist

Der eigentliche Mehrwert entsteht nicht durch die Daten selbst, sondern durch die Perspektive, die sie ermöglichen. Der Web Graph zeigt nicht nur, wer verlinkt ist, sondern in welchem Kontext Verlinkungen stattfinden. Dadurch wird sichtbar, welche Seiten zentral im Netzwerk sind und welche eher am Rand existieren. Autorität wird hier nicht als einzelne Kennzahl verstanden, sondern als Ergebnis von Beziehungen. Eine Seite ist dann stark, wenn sie gut eingebettet ist, nicht nur, wenn sie viele Links hat. Diese Sichtweise passt erstaunlich gut zu dem, was wir aktuell bei KI-Systemen beobachten. Auch dort geht es weniger um einzelne Signale und mehr um Kontext und Einordnung.

Wie SEOs diese Daten konkret nutzen können

Für SEOs eröffnet sich damit eine neue Ebene der Analyse. Statt sich ausschließlich auf Tools zu verlassen, die bereits interpretierte Daten liefern, kann man direkt an der Quelle ansetzen. Ein zentraler Anwendungsfall ist die Bewertung von Autorität unabhängig von Google. Der Web Graph zeigt, wie stark eine Domain im Gesamtgefüge des Webs verankert ist, nicht nur, wie sie aktuell rankt. Darüber hinaus lassen sich thematische Strukturen erkennen. Webseiten, die konsistent in einem bestimmten Kontext verlinkt sind, bilden Cluster. Diese Cluster sind ein starker Hinweis auf thematische Autorität.

Auch die Analyse von Nachbarschaften gewinnt an Bedeutung. Es macht einen Unterschied, ob eine Seite im Umfeld starker, vertrauenswürdiger Domains auftaucht oder in isolierten Bereichen des Webs. Diese Perspektive geht deutlich über klassische Backlink-Analysen hinaus und liefert ein tieferes Verständnis dafür, wie Inhalte wirklich eingebettet sind.

Die Verbindung zu KI-Ranking-Signalen

Der vielleicht wichtigste Punkt ist jedoch die Verbindung zu KI-Systemen.

Viele dieser Systeme wurden mit Webdaten trainiert oder greifen auf ähnliche Strukturen zurück, um Inhalte zu bewerten. Das bedeutet, dass die Sichtbarkeit im Web Graph indirekt beeinflusst, ob Inhalte in KI-Antworten berücksichtigt werden. Wenn eine Seite gut vernetzt ist, häufig vorkommt und in starken Kontexten eingebettet ist, steigt die Wahrscheinlichkeit, dass sie Teil des „Wissensraums“ der KI wird.

Damit wird klar:

Die klassische SEO-Logik und die Logik von KI-Systemen sind enger miteinander verbunden, als es auf den ersten Blick scheint.

SEO wird zur Netzwerk-Analyse

Die Nutzung von Common Crawl und dem AI Brand Authority Index verändert auch die Rolle von SEO selbst. Es geht nicht mehr nur darum, einzelne Seiten zu optimieren, sondern darum, das gesamte Umfeld zu verstehen, in dem sich eine Marke in KI-Systemen bewegt. SEO wird damit stärker zu einer Disziplin, die sich mit Netzwerken, Beziehungen und Kontexten beschäftigt. Das klingt abstrakt, ist aber im Kern eine logische Weiterentwicklung: Wenn Suchsysteme komplexer werden, muss auch die Analyse tiefer gehen.

Fazit: Wer die Daten versteht, versteht die Zukunft der Suche

Common Crawl und die Web Graph Data sind kein Ersatz für klassische SEO-Tools. Aber sie liefern etwas, das diese Tools oft nicht bieten: eine ungefilterte Sicht auf das Web.

Diese Sicht hilft dabei zu verstehen, wie Inhalte wirklich miteinander verbunden sind und welche Rolle eine Marke im digitalen Raum spielt. Gerade im Kontext von KI wird dieses Verständnis immer wichtiger. Denn die entscheidende Frage ist nicht mehr nur, wie gut eine Seite rankt, sondern wie sie im gesamten Netzwerk verankert ist.

Quelle: commoncrawl.org