Neuer Google-Agent: Warum Googles Infrastruktur gerade still umgebaut wird

24.03.2026 um 20:41 Uhr, von Anne

Google baut seine Such- und KI-Infrastruktur weiter aus und das oft leise. Mit dem neuen User-Agent „Google-Agent“ deutet sich ein struktureller Wandel an, der weit über klassisches Crawling hinausgeht. Statt nur Inhalte zu indexieren, beginnt Google zunehmend damit, Webinhalte aktiv zu nutzen, zu interpretieren und in KI-Workflows einzubinden.

Für SEO bedeutet das: Die Rolle von Webseiten verschiebt sich. Sie sind nicht mehr nur Datenquellen für Rankings, sondern zunehmend operative Bausteine in automatisierten Systemen.

Architektur-Shift: Vom Crawler-Web zum Agent-Web

Der neue User-Agent ist Teil einer technischen Differenzierung, die Google schon länger vorbereitet. Klassische Bots wie der Googlebot dienen primär der Indexierung. Neue Fetcher-Typen hingegen werden durch Nutzeraktionen oder Systeme ausgelöst und greifen gezielt auf Inhalte zu.

Das zeigt einen fundamentalen Infrastruktur-Shift:

Suchmaschinen entwickeln sich von reinen Crawling-Systemen zu agentischen Plattformen, die Inhalte situativ nutzen.

Während der Googlebot weiterhin für Ranking-Grundlagen zuständig bleibt, entsteht parallel eine zweite Schicht: Systeme, die Inhalte für konkrete Aufgaben abrufen, etwa für KI-Antworten, Tool-Workflows oder automatisierte Interaktionen.

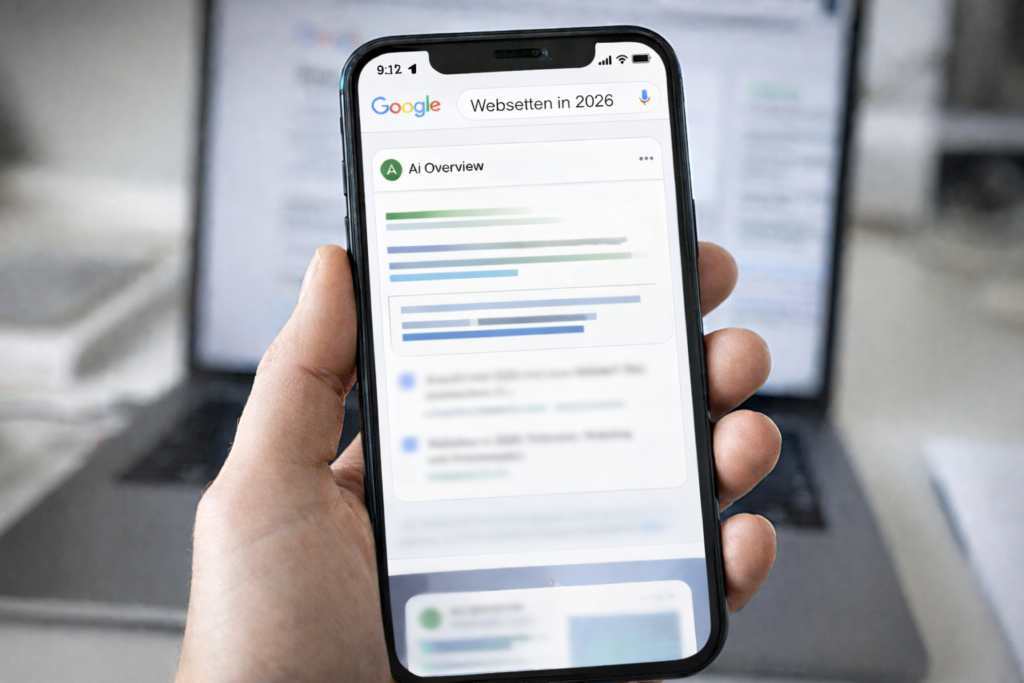

Zusasmenhang mit AI Overviews, Gemini & generativer Suche

Der neue Agent ist eng mit Googles KI-Strategie verbunden. Features wie AI Overviews oder Gemini benötigen Inhalte nicht nur zur Indexierung, sondern für dynamische Nutzung im Antwortprozess.

Das bedeutet:

Webseiten werden zunehmend Teil von Echtzeit-Wissenssystemen.

In diesem Kontext sind neue User-Agents logisch. Sie ermöglichen es Google, Inhalte situativ abzurufen, zu analysieren und in generative Antworten zu integrieren.

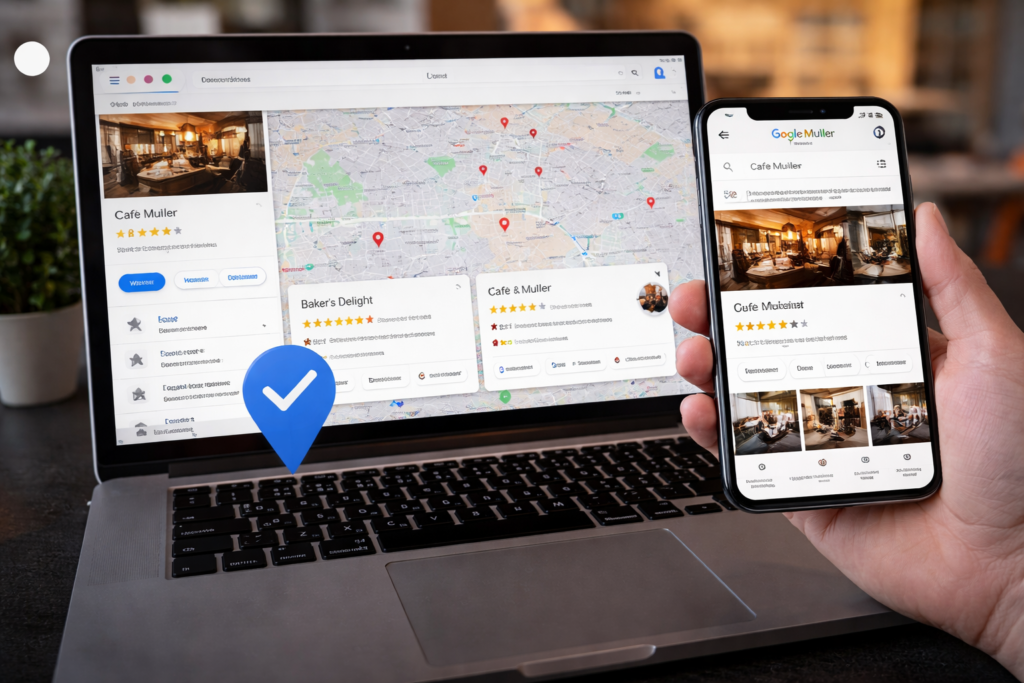

Für Publisher und Unternehmen verschiebt sich damit die Sichtbarkeitslogik:

Nicht nur Rankings entscheiden über Reichweite, sondern auch die Interpretierbarkeit durch KI-Systeme.

Warum viele den neuen Agent noch nicht sehen

Der „Google-Agent“ taucht nicht zwingend in klassischen Log-Analysen auf. Anders als der Googlebot agiert er situativ und kontextabhängig.

Er wird typischerweise nur aktiv, wenn:

- KI-Features Inhalte abrufen

- Nutzeraktionen Fetch-Requests auslösen

- Systeme Inhalte für spezifische Workflows benötigen

Diese neue Zugriffsebene bleibt für viele Websites zunächst unsichtbar, ist aber infrastrukturell bereits relevant.

Technische Handlungsempfehlungen für Websites

Mit der zunehmenden Agent-Logik verändern sich auch technische SEO-Prioritäten.

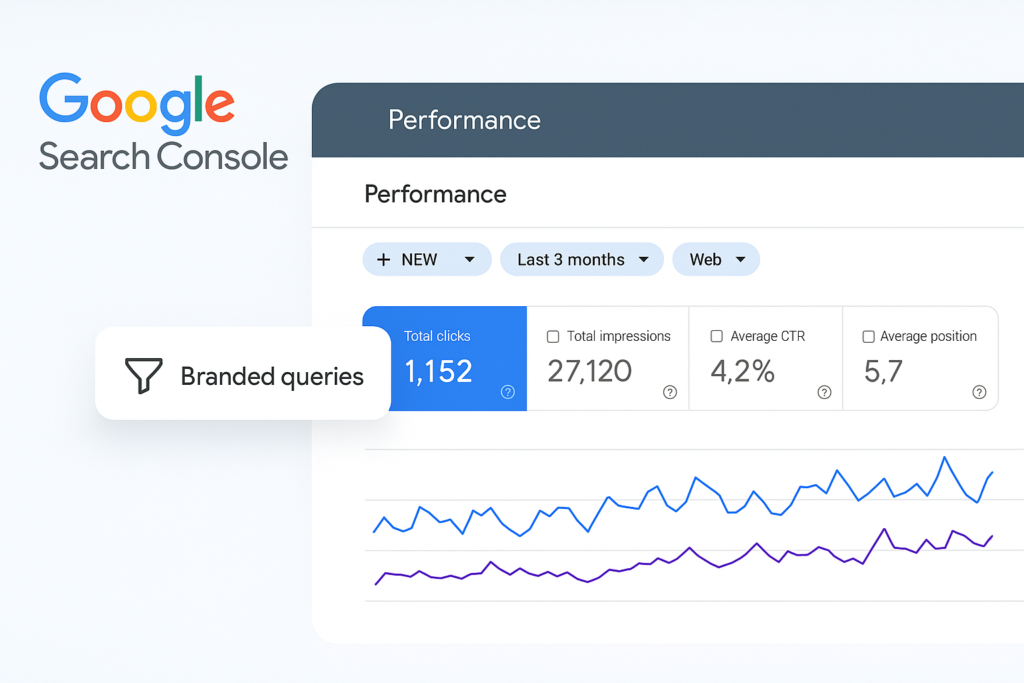

1. Logfile-Monitoring neu denken

User-Agent-Analysen sollten erweitert werden. Nicht nur klassische Bots, sondern auch neue Fetch-Typen müssen berücksichtigt werden.

2. Crawl-Budget vs. Access-Budget

Neben Indexierungs-Effizienz gewinnt die Frage an Bedeutung, wie zugänglich Inhalte für KI-Abrufe sind.

3. Strukturierte Daten ausbauen

Semantische Klarheit wird zur zentralen Voraussetzung für Interpretierbarkeit in KI-Systemen.

4. Content-Architektur konsolidieren

Fragmentierte Inhalte erschweren agentische Nutzung. Klare Entitäten und Themencluster gewinnen an Gewicht.

5. Server-Performance optimieren

KI-Fetches sind oft latenzsensibel. Infrastruktur-Performance wird stärker zum Ranking-ähnlichen Faktor.

Fazit: SEO wird infrastruktureller

Der neue Google-Agent ist kein isoliertes Update, sondern ein Signal für einen größeren Wandel. EO entwickelt sich von einer Ranking-Disziplin hin zu einer Infrastruktur-Disziplin. Webseiten müssen künftig nicht nur sichtbar, sondern auch systemisch nutzbar sein. Wer diese Entwicklung früh versteht, kann seine digitale Präsenz langfristig resilienter aufstellen.

Quelle: Chris Long / LinkedIn