Embedding-Modelle: Wie moderne KI Bedeutung versteht

08.12.2025 um 21:45 Uhr, von Anne

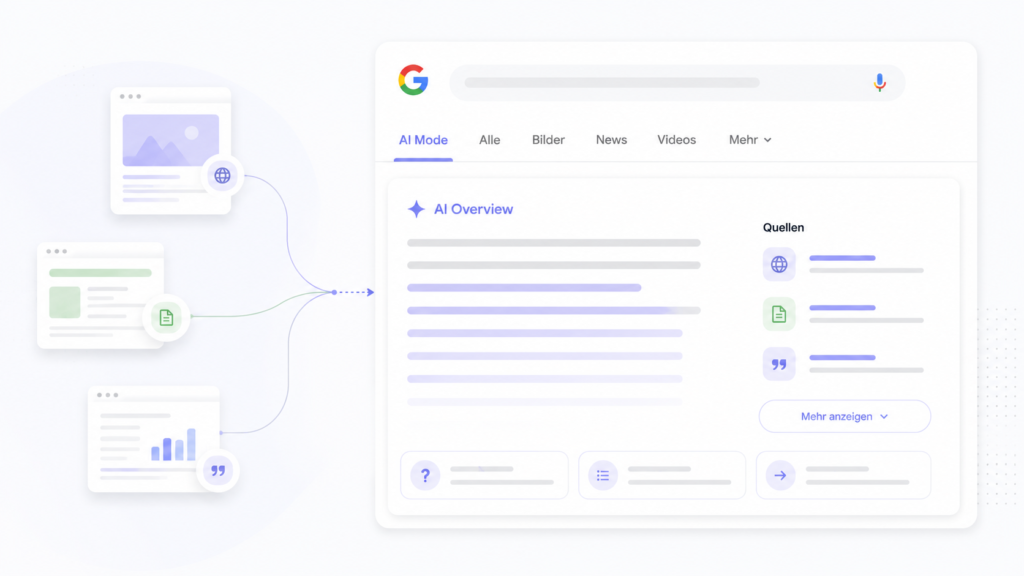

Die Suche funktioniert heute nicht mehr wie früher. Keywords allein reichen längst nicht mehr aus, um Inhalte zu verstehen oder sinnvoll zu verknüpfen. Stattdessen setzen KI-Modelle; von Google bis OpenAI auf Embedding-Modelle: hochdimensionale Zahlenräume, die Bedeutung, Kontext und Beziehungen zwischen Wörtern, Sätzen, Bildern oder ganzen Dokumenten abbilden.

Damit wird deutlich: Embeddings sind die Infrastruktur der modernen KI-Suche.

Sie bestimmen, welche Inhalte als ähnlich gelten, welche Entitäten zusammengehören und wie KI-Systeme Fragen beantworten. Doch welche Embedding-Modelle gibt es heute? Wie funktionieren sie? Und warum spielt ihre Qualität eine immer größere Rolle in SEO, Search und generativen Systemen?

Was sind Embeddings – und warum sind sie so wichtig?

Embeddings übersetzen Inhalte in Vektoren, also Zahlenreihen, die semantische Beziehungen abbilden. Statt rein statische Wörter „zu matchen“, erkennen moderne KI-Systeme:

- Bedeutungen

- Themen

- Entitäten

- Beziehungen

- Intention

Ein Embedding erkennt z. B., dass „E-Commerce SEO“, „Produktentdeckung“ und „Search-Relevanz“ thematisch näher beieinander liegen als „Katzenfutter“ oder „Wettervorhersage“. Suchmaschinen wie Google nutzen diese Technik in ihren Vektordatenbanken, um Suchanfragen, Inhalte und Webseiten semantisch zu vergleichen. KI-Assistenten wie ChatGPT oder Gemini nutzen Embeddings hingegen, um Informationen abzurufen, Antworten zusammenzustellen oder Referenzen zu erkennen.

Damit wird klar:

Embedding-Modelle sind die Grundlage für Ranking, Relevanz und Empfehlungssysteme, in der gesamten KI-Ökologie.

Welche Embedding-Modelle prägen die KI-Landschaft?

In den letzten Jahren hat sich die Entwicklung enorm beschleunigt. Statt einfacher Text-Vektoren setzen moderne Modelle auf multimodale, kontextuelle und LLM-optimierte Embeddings. Die wichtigsten Vertreter:

1. OpenAI: text-embedding-3 Large / Small

OpenAI bietet eines der leistungsstärksten kommerziellen Modelle für semantische Suche und Retrieval.

Diese Embeddings sind besonders stark in:

- semantischer Suche

- Klassifikation

- Content-Clustering

- Topic-Modelling

Das Large-Modell gilt als eines der präzisesten Embeddings am Markt. Ein Standard für RAG-Systeme und KI-basierte Suchprojekte.

2. Google: Gecko & Gecko-Multimodal (Gemini-Generation)

Googles eigene Embeddings werden über Vertex AI verfügbar. Sie sind extrem stark in:

- multimodaler Interpretation (Text + Bild)

- sehr großen Datensätzen

- Such- und Ranking-Systemen

Da Google selbst auf Vektordatenbanken basiert, spiegeln Gecko-Embeddings die Denkweise der Google-Suche besonders gut wider.

3. Cohere: Embed v3 (Multilingual)

Cohere ist führend bei Enterprise-Search. Die Modelle sind ausgelegt für:

- mehrsprachige Inhalte

- globale Teams

- hohe Skalierung

Embed v3 ist besonders stark für Firmen mit internationalen Zielgruppen.

4. Meta: E5-Large-v2 & E5-Mistral

Die E5-Modelle sind Open-Source und liefern herausragende Ergebnisse:

- hohe semantische Präzision

- stark in Retrieval

- ideal für KI-SEO & Topic-Analysen

- sehr gute Preis-/Leistung

Viele Tech-Teams nutzen E5 für eigene Suchsysteme oder KI-Pipelines.

5. HuggingFace: bge-M3 (All-in-One-Retrieval)

Das neue bge-M3 gilt als eines der besten Open-Source-Embedding-Modelle überhaupt.

Es vereint:

- Ranking

- Retrieval

- Embeddings

- Klassifikation

bge-M3 ist damit der neue Standard für Open-Source-Suchprojekte.

6. Instructor-Modelle (Microsoft / HKUST)

Instructor-Embeddings sind besonders stark, wenn es um Klassifikation geht. Sie nutzen „prompt-artige Instruktionen“, um Embeddings zu steuern — ideal für:

- Kategorie-Automatisierung

- Dokumenten-Labeling

- semantische Audits

- SEO-Strukturierung

Warum Embedding-Modelle SEO und Search fundamental verändern

Suchmaschinen und KI-Assistenten funktionieren heute wie semantische Empfehlungsmaschinen. Keywords reichen nicht mehr. Entscheidend ist:

- Welche Bedeutung hat der Inhalt wirklich?

- Wie ist er mit anderen Themen verbunden?

- Welche Entitäten treten auf?

- Wie klar ist die Struktur semantisch?

- Was versteht die KI – was nicht?

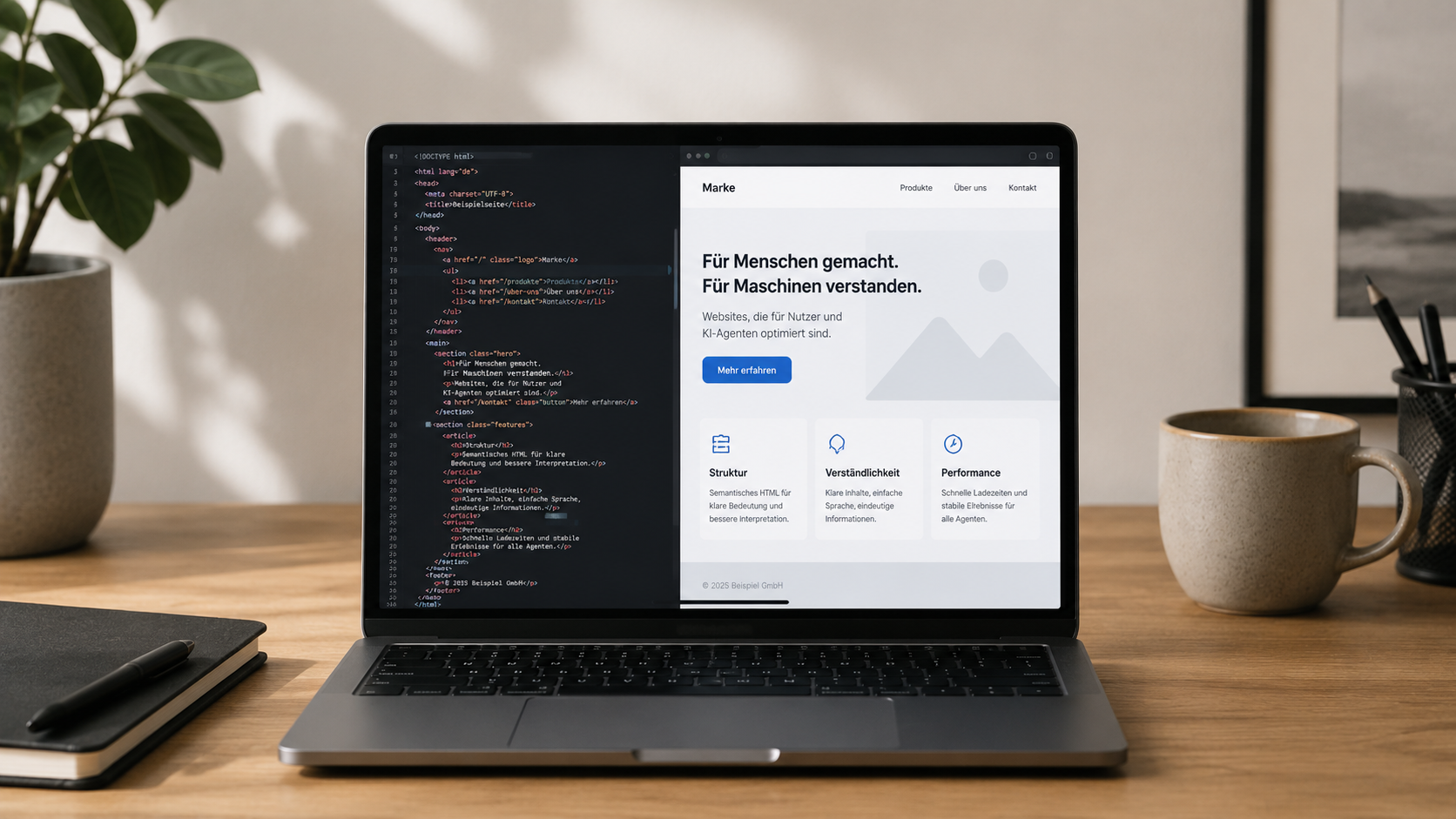

Eine KI kann nur jene Inhalte sinnvoll einordnen, die semantisch sauber, klar strukturiert und vektortechnisch konsistent sind.

Für SEO ergeben sich neue Aufgabenfelder:

- Semantische Keyword-Cluster statt Keyword-Listen

- Themenräume werden wichtiger als klassische Keywords.

- Interne Verlinkung nach semantischer Nähe

- Embeddings helfen, logische Linkstrukturen zu erkennen.

- Content so strukturieren, wie Embeddings ihn „verstehen“

- Entitäten, Klarheit, Kontext, Beziehungen.

- AI-Search-Optimierung (GEO)

- Generative Systeme greifen über Embeddings auf Inhalte zu — nur wer dort sichtbar ist, taucht auch in KI-Antworten auf.

Was Unternehmen jetzt tun sollten

1. Inhalte semantisch prüfen

Mit Embeddings lassen sich Cluster, Themenräume und Lücken erkennen.

2. Interne Verlinkungen nach Bedeutung optimieren

Nicht nach „Hauptkeyword“, sondern nach semantischer Nähe.

3. KI-Assistenten & RAG-Systeme strategisch einsetzen

Embeddings ermöglichen hochwertige Such- und Wissenssysteme im Unternehmen.

4. Content explizit „embedding-freundlich“ gestalten

Klare Entitäten, eindeutige Aussagen, kein dünner Text.

5. Tools nutzen, die Embeddings sichtbar machen

(z. B. OpenAI, Cohere, bge-M3, ScreamingFrog+KI)

Fazit: Embeddings sind das neue Ranking-Signal

Embedding-Modelle bestimmen, wie KI Inhalte versteht. Sie entscheiden über:

- Sichtbarkeit

- Relevanz

- Empfehlung

- Ranking

- KI-Antworten

- Bedeutungsräume

Wer SEO, AI-Search oder Content-Strategien ernst nimmt, kommt an Embeddings nicht mehr vorbei. Sie sind nicht nur ein technisches Feature, sie sind die Sprache, in der KI das Web interpretiert.